De la IA Generativa a la IA Cognitiva: ¿y si el próximo gran modelo de lenguaje no usara palabras, sino ondas cerebrales?

¿Es posible que las máquinas empiecen a sentirnos sin que pronunciemos una sola palabra? ¿Estamos preparados para que nuestra actividad cerebral se convierta en el nuevo estándar de datos abiertos? Aparentemete, hoy, ya es posible con el lanzamiento de ZUNA por parte de Zyphra

Si los LLM digitalizaron el conocimiento humano acumulado en la red, los modelos de base neural como ZUNA buscan digitalizar los estados humanos en tiempo real. Es decir, son capaces de crear una capa de interfaz invisible entre el pensamiento y la ejecución.

El contexto ha cambiado. Es arquitectura de escala, pesos abiertos y herramientas para desarrolladores. Es el paso de la IA generativa a la IA Cognitiva.

La transición del dato al estado

Durante décadas, el electroencefalograma (EEG) ha sido el patito feo de los datos biométricos en tecnología. Es ruidoso, desordenado y depende críticamente de cómo se coloquen los electrodos en el cuero cabelludo. Si mueves un músculo de la cara, la señal se contamina. Si el protocolo de captura cambia un milímetro, los datos dejan de ser comparables.

Sin embargo, Zyphra ha decidido tratar estas señales no como un problema médico, sino como un dominio de pre-entrenamiento masivo.

Se trata de un cambio de paradigma, ya que ZUNA no es un modelo entrenado para una tarea específica (como detectar una epilepsia), sino un Modelo Fundacional de 380 millones de parámetros entrenado con 2 millones de horas de canal de datos EEG. Al igual que GPT aprendió la estructura del lenguaje antes de saber escribir poemas, ZUNA ha aprendido la gramática de las señales neuronales.

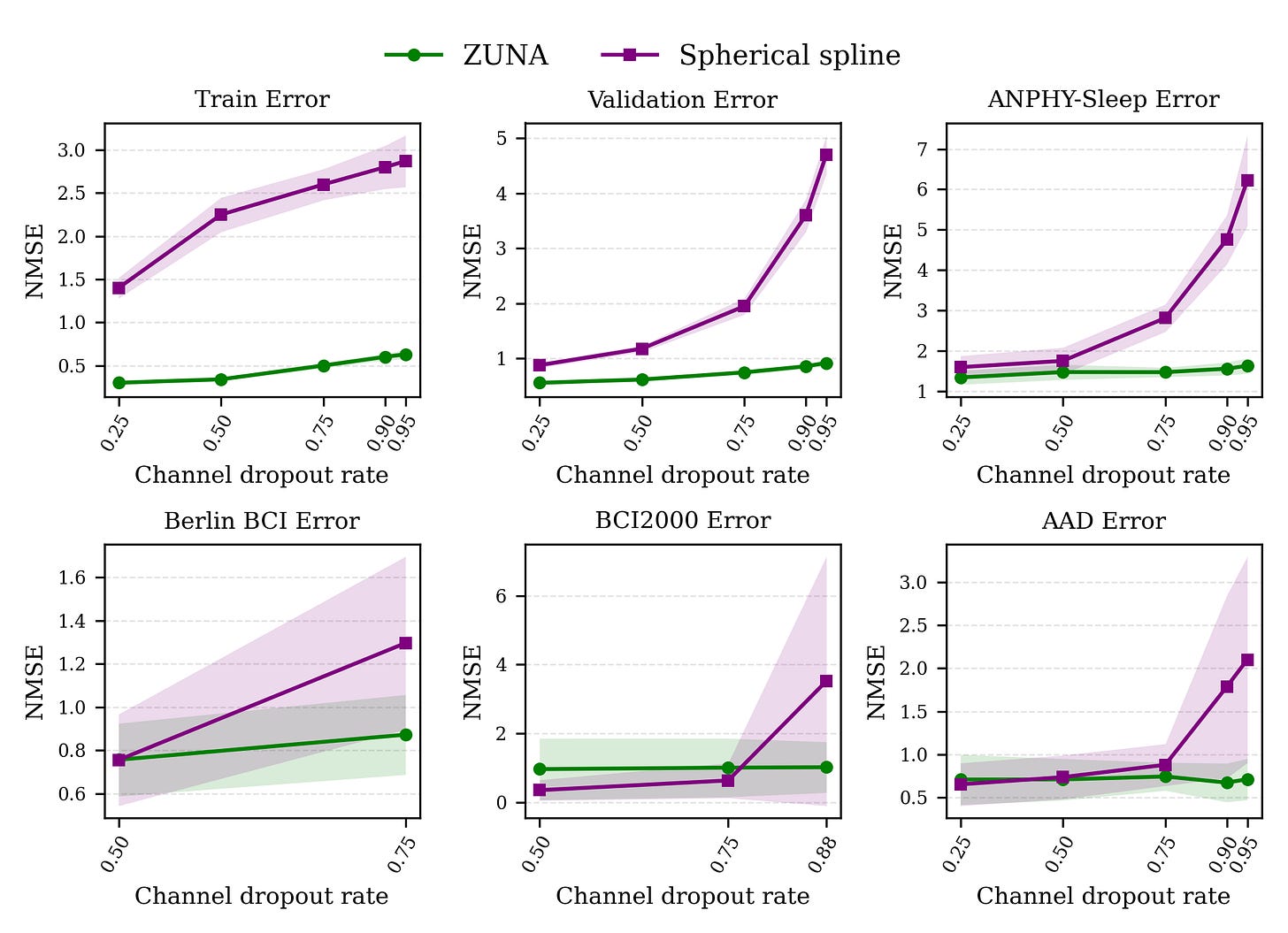

La evidencia es técnica pero demoledora. Utilizando una arquitectura de autoencoder de difusión enmascarada, el modelo es capaz de reconstruir señales faltantes, eliminar el ruido de forma mucho más eficiente que los métodos estándar (como la interpolación de splines esféricos de MNE) y, lo más inquietante, predecir señales en coordenadas del cráneo donde ni siquiera hay un sensor.

La barrera de entrada para crear interfaces cerebro-computador (BCI) acaba de desplomarse. Lo que antes requería un equipo de neurocientíficos y meses de limpieza de datos, ahora empieza a ser accesible con una GPU de consumo y un repositorio de GitHub o en Hugging Face.

De la intención a la acción

El fin de la fricción en entornos industriales

Imagina a un operario en una planta logística de alta precisión. Sus manos están ocupadas, su entorno es ruidoso para comandos de voz. Al integrar un modelo como ZUNA en un dispositivo wearable ligero, la máquina no espera a que el operario pulse un botón. Detecta el estado de carga cognitiva o la intención de movimiento antes de que se ejecute. El resultado, además de eficiente, es una extensión del cuerpo mediante agentes inteligentes que actúan como una prótesis cognitiva.

Marketing de respuesta emocional real

En el mundo del contenido, siempre hemos luchado con el sesgo de declaración: lo que el usuario dice que le gusta frente a lo que realmente siente. Un modelo capaz de reconstruir y limpiar señales de EEG en tiempo real permite medir el ROI emocional con una precisión quirúrgica. Más allá de analizar clics, se podría analizar la respuesta neural ante una narrativa de marca, eliminando el ruido del entorno para quedarnos con la esencia de la conexión.

Hemos pasado décadas aprendiendo el lenguaje de las máquinas: desde el código binario hasta los prompts de texto. Lo que ZUNA nos está diciendo es que, por primera vez, la máquina está aprendiendo el lenguaje de nuestra biología. Podría ser el primer paso hacia una tecnología que no requiere que nos adaptemos a ella, sino que se sincroniza con nuestro estado cognitivo en tiempo real. El futuro no se teclea, se piensa.

Paper → ZUNA: Flexible EEG Superresolution with Position-Aware Diffusion Autoencoders.